Endrew Ng 교수님의 Machine Learning강의를 듣고 복습하는 글입니다. (www.coursera.org)

첫번째 학습 알고리즘은 선형 회귀이다. 이번 시간에는 모델이 어떻게 생겼는지 그리고 전반적인 지도 학습 과정에 대해 알아보겠다. (Const function의 수학적 정의 위주.)

1. Model 표현 (선형 회귀)

▶선형 회귀는 지도학습의 한 종류.

▶학습 데이터를 이용하여 학습 과정을 거쳐서 데이터에 가장 잘맞는 선형 모델의 파라미터를 찾아서 예측한다.

▶즉, 종속변수 y와 한 개 이상의 독립변수 x와의 선형 상관관계를 모델링하는 회귀분석 기법.

▶대부분의 데이터들이 보통 선형(linear)으로 분포하는 경향이 있어서 선현회귀를 통해 예측 가능하다.

▶표기법

m : 학습데이터셋 개수

x : 특징이라 불리는 입력 변수

y : 출력값(예측하려는 목표 변수)

(x^(i), y^(i)) : i번째 학습(training) 예제 (인덱스로서의 i)

▶지도학습 문제를 더욱 공식적으로 설명하기 위해, 주어진 학습 데이터셋에서 h(x)가 y값(실제값)에 대한 좋은 예측 변수가 되도록 함수 h: X->Y를 배우는 것이다. 이 기능을 '가설'이라고 한다.

▶여기서 h(hypothesis)는 'x에서부터 y까지의 지도'라고 할 수 있다.

(x는 집의 크기이고, y는 예측되는 집의 가격)

▶h는 하나의 함수(선형함수)로 나타낼 수 있다.

▶h(x)는 입력값x에 따른 y를 예측하는 '가설'이다. (Θ0,Θ1은 모델 파라미터)

▶가장 간단한 선형 회귀식은 독립변수 x가 1개인 1차 방정식 형태. h(x) = Θ0 + Θ1x

->선형회귀의 값(x)은 하나이며, 이 값으로 모든 가격들을 예측하는 것이다.

(단일변량 선형회귀 라고도 한다.)

* 직선그래프는 선형회귀이고, x는 학습데이터 포인트들이다.

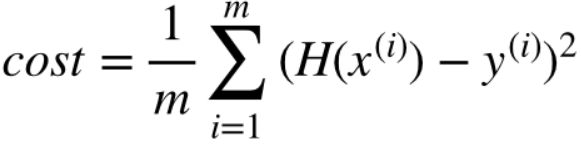

2. Const Function 비용함수

▶선형 모델의 예측(h(x))과 훈련 데이터(y) 사이의 거리를 재는 비용함수.

▶주어진 데이터에 가장 가까운 일차함수 그래프를 알아낼 수 있다. (회귀문제에서 잘 사용되는 함수.)

▶가설 h의 정확성을 높이는 함수이다.

▶각 점과 선 사이의 거리를 계산하며, 가설(선형 모델의 예측)과 실제 데이터(훈련 데이터)가 얼마나 다른지를 평가하는 것.

▶Θi : 모형들의 파라미터 ->어떤 값이냐에 따라 함수 모양(기울기와 절편)이 달라지게 된다.

즉, train set에서 h(x)가 y값에 가장 가깝도록 (데이터의 산포도와 가장 적합한 함수가 될 수 있도록)

최소값 Θ0,Θ1을 골라야한다. ->최소화 문제 (h(x)와 y간의 차이를 작게 만드는 것.)

▶차이를 나타내는 식: h(x) - y

▶해당 직선위의 빨간 점과 y값사이의 거리의 차이를 구하여 작게 만드는 것이 목표이다.

▶모든 데이터에 대한 차이를 합하여 모델을 평가하는 것이 비용 함수.

▶비용 함수의 결과값이 적을 수록 예측이 정확하다는 의미.

▶가장 적은 비용을 갖는 H(x)^i와 y^i 를 구하는과정이 모델의 훈련과정.

* Const Function은 Squarel Error Function(오차함수의 제곱)이라고도 불린다.

'지식 > Review' 카테고리의 다른 글

| 데이터 시각화 기초 (0) | 2021.01.04 |

|---|---|

| 클래스와 넘파이, 그리고 matplotlib (0) | 2021.01.03 |

| Parameter Learning (Gradient Descent) (0) | 2020.12.31 |

| Const Function - Intuition 1,2 (0) | 2020.12.28 |

| What is machine learning? (0) | 2020.12.27 |