Endrew Ng 교수님의 Machine Learning강의를 듣고 복습하는 글입니다. (www.coursera.org)

1. 머신러닝이란?

▶Field of study that gives computers the ability to learn without being explicitly programmed.

컴퓨터에게 명시적인 프로그래밍(코드) 없이 배우는 능력을 제공하는 연구 분야.

▶A computer program is said to learn from experience E with respect to some task T and some performance measure P.

Computer program은 어떠한 작업 T와 성능 측정값인 P와 관련해서 경험 자체E를 학습한다.

즉, 경험E와함께 성능P가 향상되는 것.

ex) Playing checker :

E - 많은 게임의 Checker를 하는 경험. T = Checker를 playing하는 작업. P = 프로그램이 다음 게임을 이길 확률.

ex2) Suppose your email program watches which emails you do or do not mark as spam, and based on that learns how to better filter spam. What is the task T in this setting?

E - 많은 메일의 스팸여부를 표시하는 경험. T = 이메일을 스팸으로 분류하거나 스팸이 아닌 것으로 분류하는 것을 보는 것. P = 프로그램이 메일의 스팸여부를 잘 구분할 확률.

Quiz1.

A computer program is said to learn from experience E with respect to some task T and some performance measure P if its performance on T, as measured by P, improves with experience E.

Suppose we feed a learning algorithm a lot of historical weather data, and have it learn to predict weather. What would be a reasonable choice for P?

Answer)

E - 다량의 historical weather data를 학습하는 경험. (The process of the algorithm examining a large amount of historical weather data.)

T = weather 예측하는 작업. (The weather prediction task.)

P = 프로그램이 날씨를 예측할 확률. (The probability of it correctly predicting a future date's weather.)

▶일반적으로, 머신러닝 알고리즘은 지도학습(supervised learning)과 비지도학습(unsupervised learning) 두 분류 중 하나로 할당된다. (강화학습, 추천시스템 등도 있긴 하다.)

2. 지도학습 알고리즘

▶알고리즘에게 정답이 있는 데이터 집합을 주어서, 알고리즘은 정답을 많이 만들어야한다. (그 정답을 많이 학습할수록 새로운 데이터에 대한 예측률이 높아지는 것)

▶회귀문제와 분류문제

회귀문제 : 연속적인 출력값을 가진 결과를 예측

ex)3개월 안에 A물건이 몇개 팔릴지 예측.

분류문제 : 불연속적인, 이산적인 출력값(0 또는 1)을 예측. 결과값이 2개 이상일 수도있다.

ex)고객들의 정보가 해킹된 정보인지 아닌지 예측.

ex) Housing price prediction -집크기에 따른 가격 예측(x: size in feet, y: price in 1000) : 회귀문제 regression problem

직선을 선택할지 이차함수를 선택할지 정해야한다.

size가 350일 경우,

직선: 150k

이차함수: 200k -> 더 정확한 것을 알 수 있음.

But,집이 요구한 가격(200k)보다 적은 가격으로 팔리는지 이상의 가격으로 팔리는지에 대한 값을 출력값으로 하는 분류문제로 해결할 수 있다.

ex2) Breast cancer -유방암이 악성인지 약성인지 예측(x: Tumor size, y: Malignant) : 분류문제 classification problem

종양 크기에 따라 종양이 악성일 가능성을 예측 가능.

2)다른 방법의 도식화로, 단 하나의 속성일 때 가능.

만약, 하나의 속성이 더 있다면?

Age속성이 추가되면,

양성을 o로, 악성을 x로 표시할 수 있다.

->해당 종양크기와 나이일 경우, 양성이라 예측 가능.

이보다 더 많은 특성이 있을 수 있는데, 이렇게 많은 용량의 특성을 컴퓨터가 다루기 위해 수학적 방법(알고리즘)으로 예측이 가능하다.

Quiz2.

Suppose you are working on stock market prediction. You would like to predict whether or not a certain company will declare bankruptcy within the next 7 days (by training on data of similar companies that had previously been at risk of bankruptcy). Would you treat this as a classification or a regression problem?

Answer) Regression.

3. 비지도학습 알고리즘

▶알고리즘은 데이터 집합에 대한 정답을 학습하지 않고, 단지 데이터 변수간의 관계를 바탕으로 데이터를 클러스터링하여 구조를 예측하는 알고리즘이다.

▶그래프로는,

▶지도학습과 비지도학습의 차이로 이해해보자면,

- label 여부 :

지도학습은 label이 있는(이미 정답이 있는) 데이터를 예측하거나 분류하는 것

비지도학습은 label이 없는 데이터에서 패턴을 발견하고 구조를 찾는 것

- 평가 여부:

지도학습은 데이터의 정체를 알고 있기 때문에, 분류에 대한 평가가 가능하고 오답률을 구할수 있다.

비지도학습은 평가할만한 기준이 없다. 단지, 위 사진처럼, 두개의 지점을 기준으로 데이터들이 군집을 형성하고 있다 는 것만 알 수 있다.

▶클러스터링 분류 문제

ex) Google News : 매일 올라오는 기사들을 같은 topic 별로 자동 분류하여 묶는다.

ex2) 유전학적 자료 이해 : 특정 유전자의 발현 정도에 따라서 사람들을 서로 다른 분류 및 타입으로 묶는다.

ex3) 대규모 컴퓨터 클러스터 구성 : 대규모 컴퓨터를 보고 어떤 기기들이 주로 같이 일하는지 파악 후, 같이 두면 더 효율적인 datacenter를 마련할 수 있다.

ex4) Social Network Analysis, Market segmentation(고객 분석), Astronomical data analysis(천문학 데이터 분석) 등

▶칵테일 파티문제 (Cocktail party problem)

- 오디오 처리에 사용된 문제이다.

: 2가지 마이크가 2개의 speaker로부터 서로 다른 거리에서 녹음을 하면, 알고리즘은 각각 2개의 audio source를 분리하여 출력한다. -> 혼란스러운 환경에서 구조파악이 가능하다.

- 이는 단 한줄의 코드로 된 알고리즘이다.

# svd (singular value decomposition) : 특이값 분해 함수

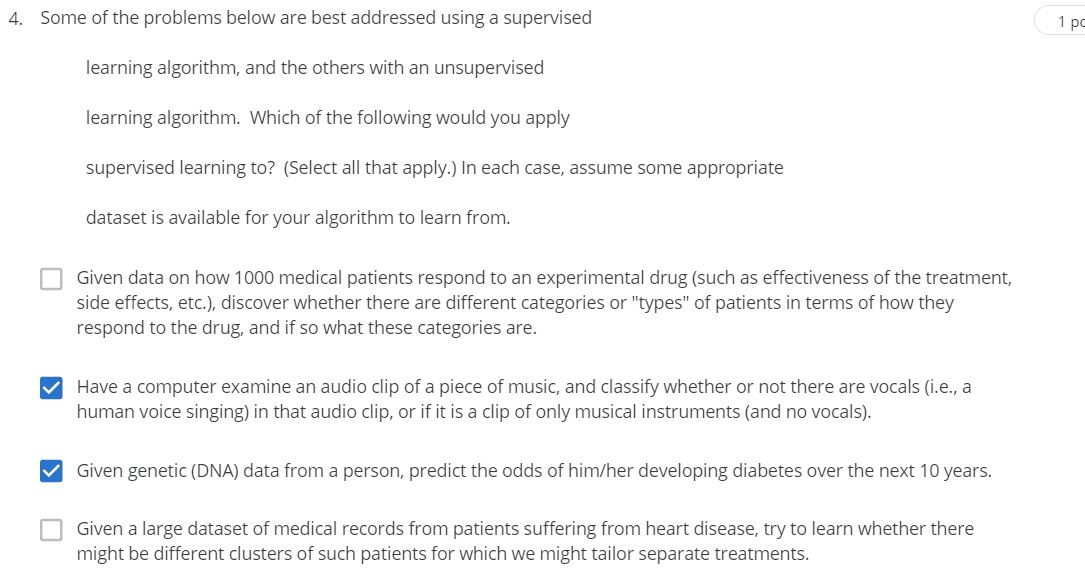

Quiz4. supervised learning 예시를 고르는 문제

(1) 주어진 1000개의 medical patients 데이터로, 다른 카테고리인지를 구분하는 것이므로 비지도학습.

(2) 음악의 오디오 클립을 검사하고, 보컬을 썼는지 안썼는지 혹은 단지 음악악기만을 사용했는지를 분류하는 것이므로 지도학습의 분류문제.

(3) 주어진 DNA 데이터로, 향후 10년간 당뇨벙에 걸릴지 예측하는 지도학습의 분류문제.

(4) 심장병으로 고통받는 환자의 대량의 medical records가 주어졌고, 그러한 patients의 다른 클러스터인지 아닌지 배우는 것.

다음 시간에는 선형회귀에 대해 정리하겠다.

'지식 > Review' 카테고리의 다른 글

| 데이터 시각화 기초 (0) | 2021.01.04 |

|---|---|

| 클래스와 넘파이, 그리고 matplotlib (0) | 2021.01.03 |

| Parameter Learning (Gradient Descent) (0) | 2020.12.31 |

| Const Function - Intuition 1,2 (0) | 2020.12.28 |

| Linear Regression(선형 회귀) (0) | 2020.12.27 |